Fish-Inspired Laundry Filter Shows Early Promise Against Microplastics

Le Future of Life Institute vient de publier l’édition 2025 de son AI Safety Index, un rapport qui évalue les pratiques de sécurité des principales entreprises développant des intelligences artificielles avancées.

Les conclusions sont sans appel : aucune entreprise n’atteint l’excellence en matière de sécurité, et le secteur dans son ensemble reste dangereusement mal préparé face aux risques existentiels que pourraient poser les IA futures.

Sur les huit entreprises évaluées, aucune n’obtient une note maximale. Le meilleur résultat revient à Anthropic avec un simple C+, suivi d’OpenAI (C) et de Google DeepMind (C-). Les autres acteurs ( xAI, Z.ai, Meta, DeepSeek et Alibaba Cloud) obtiennent des notes nettement inférieures, allant de D à F.

Cette situation révèle que même les leaders du secteur se situent tout au plus dans la moyenne. L’industrie de l’IA, malgré ses ambitions affichées de développer des systèmes toujours plus puissants, est loin de disposer des garde-fous nécessaires.

Malgré certaines critiques, Anthropic demeure l’entreprise la plus responsable selon l’index. Elle se distingue par une gouvernance solide (statut de Public Benefit Corporation), des efforts significatifs en recherche de sécurité, un cadre de sécurité relativement développé et une communication transparente sur les risques.

Toutefois, des faiblesses importantes subsistent. Le rapport souligne notamment l’absence récente d’essais sur l’amélioration des capacités humaines dans le cycle d’évaluation des risques, ainsi qu’un passage par défaut à l’utilisation des interactions des utilisateurs pour l’entraînement des modèles.

Les recommandations adressées à Anthropic incluent la formalisation de seuils de risques mesurables, la documentation de mécanismes concrets d’atténuation, l’amélioration de l’indépendance des évaluations externes et la publication d’une version publique robuste de sa politique de lanceurs d’alerte.

OpenAI se distingue par un processus d’évaluation des risques plus large que certains concurrents et par la publication, unique parmi ses pairs, d’une politique de lanceur d’alerte (whistleblowing) suite à sa médiatisation.

Néanmoins, le rapport appelle l’entreprise à aller plus loin : rendre ses seuils de sécurité réellement mesurables et applicables, accroître la transparence vis-à-vis des audits externes, et surtout aligner ses positions publiques avec ses engagements internes.

DeepMind montre des progrès en matière de transparence, ayant notamment complété le questionnaire de l’AI Safety Index et partagé des éléments de politique interne, comme son dispositif de « whistleblowing ».

Cependant, les fragilités persistent : l’évaluation des risques reste limitée, la validité des tests externes est jugée faible, et le lien entre la détection de risques et le déclenchement de mesures concrètes demeure flou.

Certaines entreprises ont entamé des démarches d’amélioration. Par exemple, xAI a publié un cadre de sécurité pour ses « IA de frontière », et Meta a formalisé un cadre avec seuils et modélisation des risques.

Mais les évaluations restent superficielles ou incomplètes : les couvertures de risque sont restreintes, les seuils peu crédibles, les mécanismes d’atténuation flous ou absents, et la gouvernance interne insuffisante. On note notamment l’absence de politique de lanceurs d’alerte et un manque d’autorité claire en cas de déclenchement de risques.

Pour les entreprises les moins bien notées, notamment DeepSeek et Alibaba Cloud, les progrès constatés sont très modestes, principalement sur la publication de cadres de sécurité ou la participation à des standards internationaux.

Le constat le plus alarmant du rapport concerne la sécurité existentielle, c’est-à-dire la capacité à prévenir des catastrophes majeures comme la perte de contrôle ou le mésalignement (misalignment).

Pour la deuxième édition consécutive, aucune entreprise n’obtient une note supérieure à D dans ce domaine. Cela signifie qu’en dépit des ambitions exprimées par certains acteurs de développer une AGI ou une superintelligence dans la décennie, aucune démarche crédible et concrète de planification pour garantir le contrôle ou l’alignement à long terme n’a été mise en place.

Un membre du comité d’experts qualifie ce décalage entre la cadence des innovations techniques et l’absence de stratégie de sécurité de profondément alarmant.

Cette situation pose plusieurs défis majeurs :

Un risque structurel : Si les entreprises continuent à développer des IA sans plans tangibles de contrôle existentiel, nous pourrions nous diriger vers des systèmes dont le comportement échappe à tout encadrement, posant potentiellement un danger global.

Un problème de gouvernance collective : L’absence d’un standard universel, d’un plan de surveillance indépendant ou d’une régulation contraignante rend la sécurité de l’IA dépendante de la bonne volonté des entreprises.

Une dissonance entre ambitions et préparation : Nombreuses sont les acteurs qui visent l’AGI dans la décennie, mais aucun ne démontre qu’il a envisagé, préparé ou traduit cela en mesures concrètes.

Face à ce constat, le rapport formule plusieurs recommandations à destination des entreprises, des régulateurs et des décideurs publics.

D’abord, les entreprises doivent dépasser les déclarations d’intention et produire des plans concrets, chiffrés et mesurables, avec des seuils de risque clairs, des mécanismes d’alerte, des protocoles d’atténuation et une vraie gouvernance interne, idéalement avec une surveillance indépendante..

Ensuite, les entreprises devraient s’engager publiquement à respecter des standards communs, par exemple en adoptant l’AI Act dans l’Union Européenne ou un code de bonnes pratiques similaire, et en coopérant à des initiatives globales de gouvernance de l’IA.

Enfin, en cas d’intention réelle de développer des IA très puissantes, les acteurs doivent clarifier leurs objectifs et expliquer comment ils comptent garantir le contrôle, l’alignement et la prévention des risques existentiels.

Il convient de noter que les évaluations reposent sur des éléments publics ou documentés. Il ne s’agit pas d’audits internes secrets, mais d’observations sur ce que les entreprises ont rendu public ou déclaré. Par conséquent, l’index mesure ce que l’on sait des pratiques, ce qui signifie que des efforts internes invisibles pourraient exister sans être capturés.

De plus, l’édition 2025 couvre des pratiques jusqu’à début novembre 2025 et ne prend pas en compte les événements récents, lancements de nouveaux modèles ou annonces postérieures à cette date.

AI Safety Index 2025 : la méthodologie

Sources d’information Système de notation

Limites reconnues L’édition 2025 couvre les pratiques jusqu’à début novembre 2025 et ne prend pas en compte les événements, lancements de modèles ou annonces postérieures à cette date de collecte. |

The post AI Safety Index 2025 : un bilan inquiétant de la sécurité de l’IA appeared first on Silicon.fr.

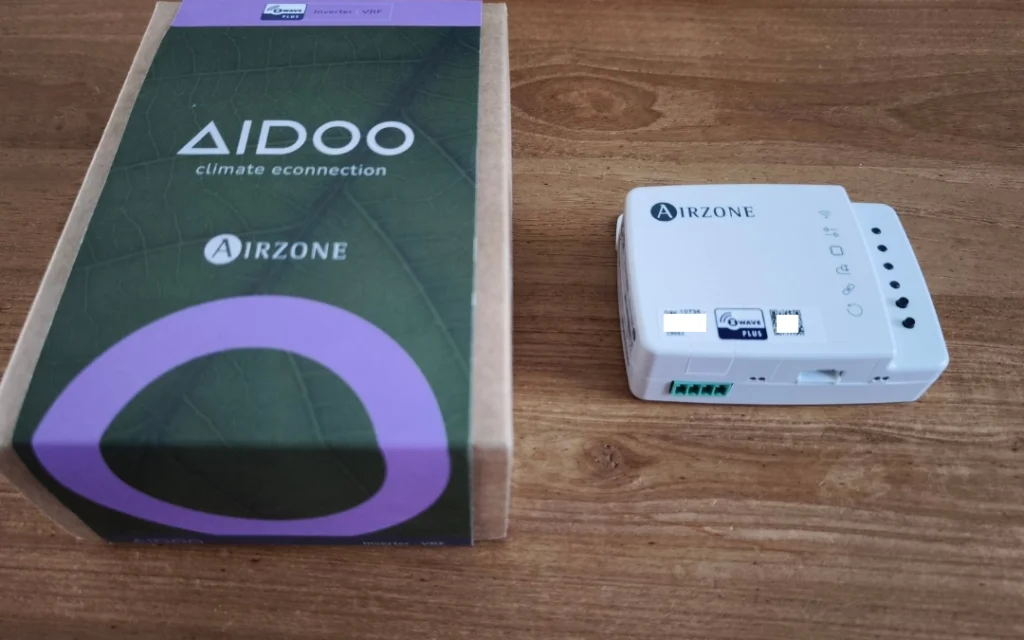

Votre système de chauffage/climatisation de type cassette ou gainable n’est pas pilotable par votre système de domotique et vous souhaitez pouvoir le connecter ? Le dispositif Aidoo de Airzone est fait pour vous. Il permet la gestion et l’intégration à distance d’unités de climatisation en particulier pour la marque Mitsubishi Electric, Mitsubishi Heavy, LG, Toshiba, […]

Votre système de chauffage/climatisation de type cassette ou gainable n’est pas pilotable par votre système de domotique et vous souhaitez pouvoir le connecter ? Le dispositif Aidoo de Airzone est fait pour vous. Il permet la gestion et l’intégration à distance d’unités de climatisation en particulier pour la marque Mitsubishi Electric, Mitsubishi Heavy, LG, Toshiba, […]

Une belle interview dans l'émission Totemic de Rebecca Warrior, la chanteuse de Sexy Sushi, Mansfield Tya, Kompromat, et autrice d'un livre qui vient de sortit, récompensé par le prix de Flore : “Toutes les vies”. Elle y raconte son amour pour une femme, la maladie qui la tue, puis la fuite autant que la quête spirituelle et artistique qui s’ensuit.

TL:DR : téléphone == mouchard

Recommandations à partir de la page 27

— Permalink

Pour les personnes qui préfèrent une version éprouvée, KeePassXC 2.7.9 a reçu le 17 novembre une certification CSPN-2025/16 de l'ANSSI, obtenue pour trois ans. La petite application a même été mise en avant dans une publication du 21 novembre sur la sécurité des mots de passe.

Sauf pour France Travail qui trouve que #Keepass et #KeepassXC ne sont pas sécurisé et qu'ils ne doivent pas être utiliser (pour le #TOTP comme pour les #PassKeys)), tous comme Firefox d'ailleurs. Pour France Travail la sécurité c'est Chrome avec l'acceptation des cookies tiers, #Fido 2 (Windows Hello/clef Fido), Windows Authentificator.

Bref, moi j'aime beaucoup #KeepassXC, je suis content qu'ils aient pu obtenir une certification, c'est une bonne reconnaissance du travail fait.

This collection of examples discussing the question of the intrinsic security characteristics of programming languages. Through illustrations and discussions, it advocates for a different vision of well-known mechanisms and is intended to provide some food for thoughts regarding languages and development tools, as well as recommendations regarding the education of developers or evaluators for secure software.

Avec JUPITER, l’Europe entre dans l’ère exascale.

Cette promesse faite début septembre à l’inauguration du supercalculateur est validée dans le dernier TOP500. Le système a atteint 1 exaflops tout rond, soit un milliard de milliard d’opérations par seconde en précision 64 bits.

Une telle puissance favorise – voire conditionne – la mise en œuvre des projets qui ont obtenu du temps de calcul. Aux dernières nouvelles, ils sont une centaine, sélectionnés principalement par deux voies. D’un côté, un « programme d’accès anticipé »

porté par EuroHPC. De l’autre, une « compétition IA »

organisée par le Gauss Centre for Supercomputing (GSC), qui réunit les trois centres de calcul nationaux allemands.

L’un de ces centres – le JSC, situé à Juliers, en Rhénanie-du-Nord-Westphalie – héberge JUPITER. À l’occasion de l’inauguration, il avait mis en avant deux projets, consacrés respectivement à la simulation quantique et climatique.

Le premier vient d’atteindre son objectif : simuler un ordinateur quantique universel à 50 qubits, avec une version compilée de l’algorithme de Shor (factorisation d’entiers) et un recuit quantique du modèle de Hubbard (interaction entre électrons). Il bat ainsi le record précédent de 48 qubits, établi par une autre équipe du JSC sur le superordinateur K (aujourd’hui décommissionné ; il était localisé au Japon).

L’architecture mémoire hybride des puces NVIDIA GH200 qui composent la partition JUPITER Booster y a contribué. Le logiciel de simulation a été adapté pour en tirer parti. Plus précisément, pour permettre des débordements temporaires vers la mémoire CPU avec une perte minimale de performance.

D’autres innovations y ont été greffées. Dont une méthode d’encodage des octets divisant par 8 la quantité de mémoire nécessaire. Et un algorithme dynamique optimisant en continu les échanges de données.

Le deuxième projet doit approfondir des travaux conduits sur le supercalculateur Alps (Suisse) par l’Institut Max-Planck de météorologie. Il s’agit d’optimiser le modèle climatique ICON pour le faire passer à l’échelle sur les 24 000 GPU de JUPITER, afin d’aboutir à des simulations sur une échelle de plusieurs décennies, à une résolution de l’ordre du km, et en incluant le cycle carbone complet.

Dans le domaine de la physique, l’exascale bénéficiera par exemple à l’université de Bonn, dans son projet d’étude de la formation des éléments lourds, vu le nombre de particules impliquées. Il s’agira, en particulier, d’explorer les propriétés des objets les plus denses de l’Univers : les étoiles à neutrons.

L’université de Cologne estime elle aussi avoir besoin d’une puissance exaflopique, dans le cadre d’un projet touchant à la dynamique des liquides biologiques. Elle souhaite comprendre l’organisation des micro-organismes actifs (algues, bactéries, spermatozoïdes…) et les structures qui se forment à des échelles bien plus grandes. Des applications sont envisagées dans la robotique en essaim, la capture du carbone et les biocarburants.

L’université de Hambourg perçoit également un bénéfice à l’exascae dans son étude de la turbulence magnétohydrodynamique (comportement d’un fluide porteur de charges électriques en présence de champs électromagnétiques), vu l’extrême gamme dynamique induite.

Pour l’université de Ratisbonne, un supercalculateur exaflopique est synonyme de boîtes spatio-temporelles plus grandes pour l’étude de la physique des quarks et des gluons. Et de précision accrue à basse énergie.

À l’université de technologie de Darmstadt, on s’intéresse à la dynamique de combustion de l’hydrogène, très différente de celle des carburants conventionnels. L’exascale doit permettre de descendre à l’échelle de la nanoseconde et de capturer la structure des flammes turbulentes au micromètre près.

De par les échelles de temps qu’implique son projet d’étude de l’interaction onde de choc – couche limite, l’université de Stuttgart entend aussi trouver un bénéfice dans l’exascale. Comprendre ce phénomène est crucial pour améliorer la conception des cellules et des systèmes de propulsion des aéronefs… et, au bout, réduire l’empreinte carbone.

L’Institut Max-Planck de biophysique mise sur JUPITER pour la simulation dynamique des pores nucléaires, qui font partie des plus grands complexes protéiques. Comprendre comment y est régulé le transport moléculaire promet des débouchés thérapeutiques et dans les nanotechnologies.

Quelques projets sélectionnés par EuroHPC visent à développer des modèles d’IA. Par exemple à l’université Louis-et-Maximilien de Munich : des modèles de diffusion « légers » pour générer de la vidéo. L’exascale doit permettre d’entraîner sur de gros datasets et ouvrir la voie à des LLM capables de généraliser bien au-delà de leurs données d’entraînement.

Des projets de LLM, il y en a à foison parmi ceux qu’a retenus le GSC. Celui que projette la PME française Dragon LLM (ex-Lingua Custodia ; voir notre article à son sujet) en fait partie. Celui de Tilde aussi. L’entreprise lettone vise un LLM focalisé sur les langues baltiques et d’Europe de l’Est. Elle mise sur JUPITER pour générer des données synthétiques grâce à des modèles open weight.

L’université d’Édimbourg attend elle aussi beaucoup en matière de génération de données synthétiques. En particulier de longs documents et de chaînes de pensée, son projet étant censé produire des modèles de raisonnement.

Du côté de la Bibliothèque nationale de Suède, on projette un LLM spécial langues scandinaves. On compte sur JUPITER pour pouvoir entraîner de plus gros modèles et exploiter de plus gros datasets.

Chez Multiverse Computing (Espagne), on travaille sur des techniques de compression des modèles, avec un focus sur DeepSeek-R1 (671 milliards de paramètres). Textgain (Belgique) s’appuie quant à lui sur le projet CaLICO (modèle de modération de contenu) pour développer des encodeurs de texte capables de créer efficacement des représentations contextualisées. Il espère que la puissance de JUPITER lui permettra d’aller chercher des sources qu’il n’a pas exploitées jusque-là, comme les réseaux sociaux.

Le GSC a aussi sélectionné le Centre européen pour les prévisions météorologiques à moyen terme (ECMWF), qui porte un projet de modélisation de la Terre à résolution kilométrique. Il a également accordé du temps de calcul à l’université Sapienza de Rome et au Cryprus Institute. La première a un projet d’étude de l’échauffement et de la traînée aérodynamique dans les véhicules super et hypersoniques. Le second s’intéresse à la chromodynamique quantique pour analyser la structure des constituants fondamentaux de la matière.

La construction de JUPITER avait démarré en décembre 2023.

Au printemps 2024, un « modèle réduit » (JEDI, JUPITER Exascale Development Instrument) avait été mis en service. Ayant permis de développer la stack de gestion du supercalculateur, il a fini par se hisser en tête du Green500, à 72,7 Gflops/W.

Un premier stade d’évolution avait été atteint fin 2024 avec la mise en service de JETI (JUPITER Exascale Transition Instrument). Cette itération à 10 racks représentait 1/12 de la puissance finale attendue. Elle avait atteint 83 Pflops au TOP500, se classant 18e.

La partition Booster était apparue dans ce même TOP500 en juin 2025, avec une performance de 793 Pflops.

Une partition Cluster, fournie par ParTec (Allemagne), doit encore être ajoutée. Elle a pris du retard, concomitamment au processeur censé l’équiper : le Rhea-1 du français SiPearl.

Illustration © Forschungszentrum Jülich / Sascha Kreklau

The post JUPITER atteint l’exascale : que fait-on avec ce supercalculateur ? appeared first on Silicon.fr.

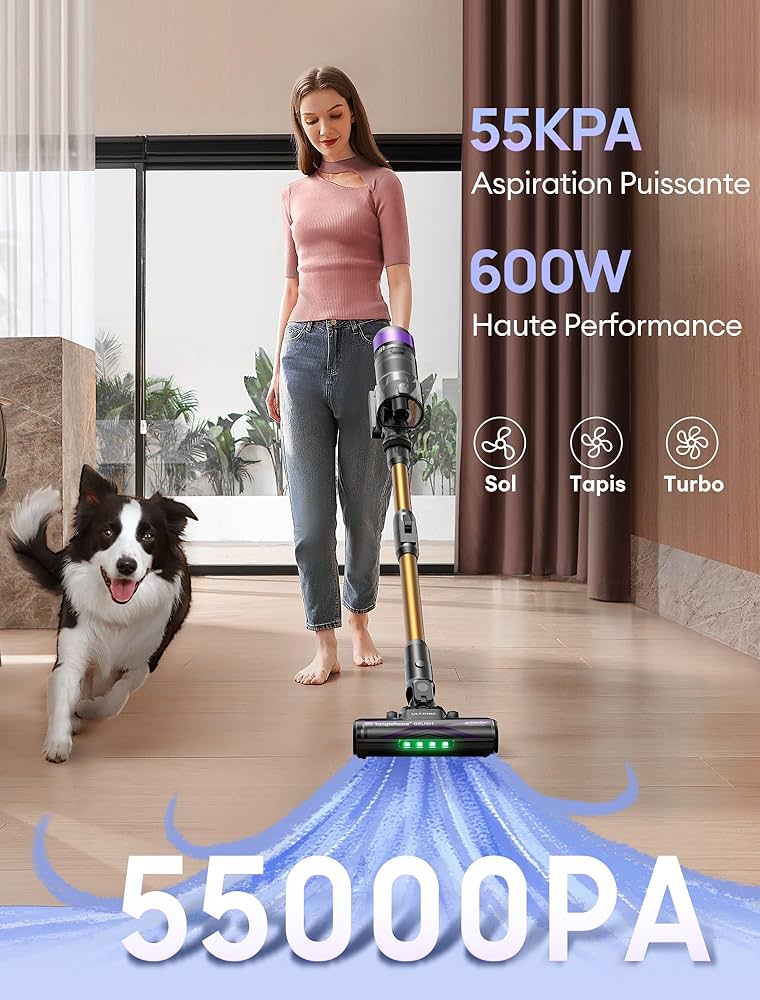

Le moment que vous attendiez est enfin arrivé. L’événement Black Friday débarque sur Amazon.fr, et avec lui une offre frappante pour l’aspirateur sans fil Ultenic U20. Imaginez : un appareil haut de gamme à prix mini, code promo exclusif, aucun plafond d’achat. Si vous cherchez à faire un bon investissement pour l’entretien de votre intérieur — tapis, parquets, recoins — restez avec moi : je vous présente pourquoi l’Ultenic U20 mérite votre attention, et surtout comment profiter de cette offre exceptionnelle, ça se passe plus bas

Voici un tableau récapitulatif des caractéristiques clés de l’Ultenic U20 :

| Caractéristique | Détail |

|---|---|

| Motorisation / Puissance | 600 W moteur, aspiration jusqu’à 55 000 Pa |

| Autonomie | Jusqu’à ~60 minutes en usage standard. |

| Capacité du bac à poussière | 1,5 L, ce qui est généreux pour ce segment. |

| Poids / maniabilité | Environ 3,3 kg selon constructeur. |

| Filtration | Filtre HEPA H12 7-couches, adapté aux allergies. |

| Design / praticité | Manche flexible (bending wand), mode auto-portant (« self-standing ») pour rangement facile. |

Voici les conditions de l’offre à ne pas manquer :

Astuce : ajoutez le produit à votre panier dès maintenant, appliquez le code promo et vérifiez que le prix descend bien à 139,49 € avant de finaliser.

Astuce : ajoutez le produit à votre panier dès maintenant, appliquez le code promo et vérifiez que le prix descend bien à 139,49 € avant de finaliser.

L’Ultenic U20 est un excellent choix si :

En revanche, si vous avez beaucoup de moquettes épaisses ou de tapis shaggy, ou des besoins extrêmes en puissance pour les animaux, il est possible qu’un modèle haut de gamme fasse la différence.

En résumé : l’Ultenic U20 combine de solides spécifications, une ergonomie conviviale et un prix imbattable dans ce contexte de Black Friday. Avec le code BFDEALU20, vous accédez à ce modèle pour 139,49 € — un tarif très compétitif pour un aspirateur sans fil de cette trempe. Si vous envisagez un achat pour cet hiver ou souhaitez anticiper les fêtes, c’est le moment idéal.

N’attendez pas : l’offre est limitée dans le temps (jusqu’au 1er décembre) et les codes promo peuvent être rapidement activés ou modifiés. Profitez-en maintenant sur Amazon.fr !

N’attendez pas : l’offre est limitée dans le temps (jusqu’au 1er décembre) et les codes promo peuvent être rapidement activés ou modifiés. Profitez-en maintenant sur Amazon.fr !

Sur Amazon.fr, ajoutez le produit au panier, puis lors de la validation entrez le code « BFDEALU20 » dans la section « Code promo ». Le prix doit descendre à 139,49 €.

L’offre concerne précisément le modèle Ultenic U20 sans mention d’accessoires supplémentaires ou bundle. Vérifiez que c’est bien ce modèle standard.

Ultenic annonce jusqu’à 60 minutes en usage standard. En mode turbo ou sur surfaces difficiles, l’autonomie peut être moindre.

Oui, le modèle proposé est destiné au marché EU.

Cet article original intitulé Bon Plan Black Friday : Aspirateur sans fil Ultenic U20 a été publié la première sur SysKB.

Microsoft et Nvidia prévoient d’investir jusqu’à 15 milliards $ dans Anthropic, respectivement 5 milliards et 10 milliards. Parallèlement, l’inventeur de Claude s’engage à acheter pour 30 milliards $ de capacité de calcul auprès de Microsoft.

Satya Nadella, CEO de Microsoft, a indiqué que les deux sociétés deviendraient « de plus en plus clientes l’une de l’autre », en précisant que Microsoft continuerait à considérer OpenAI comme « un partenaire critique ».

Microsoft rendra les modèles Claude accessibles aux clients d’Azure AI Foundry. Cela fera de Claude le seul modèle de pointe disponible sur les trois principaux fournisseurs de cloud ( AWS, Microsoft Azure et Google Cloud).

Anthropic prévoit d’utiliser jusqu’à 1 gigawatt de capacité de calcul reposant sur les architectures Grace Blackwell et Vera Rubin de Nvidia. Des spécialistes du secteur estiment qu’un gigawatt de capacité de calcul dédiée à l’IA peut représenter un coût allant de 20 à 25 milliards de dollars.

Les équipes d’ingénierie de Nvidia travailleront avec celles d’Anthropic pour assurer une meilleure intégration entre les futurs modèles et les futures générations de puces.

Cependant, Anthropic continuera de s’appuyer principalement sur AWS. Rappelons qu’Amazon a déjà investi 8 milliards $ dans la scale-up.

The post Microsoft et Nvidia vont investir 15 milliards € dans Anthropic appeared first on Silicon.fr.