After two years of vibecoding, I'm back to writing by hand

Un retour d'expérience sincère et sensé qui souligne les problèmes du vibe coding dans des projets d'envergure.

Malheureusement, tous les devs n'ont pas cette déontologie.

— Permalink

Un retour d'expérience sincère et sensé qui souligne les problèmes du vibe coding dans des projets d'envergure.

Malheureusement, tous les devs n'ont pas cette déontologie.

Un retour d'expérience sincère et sensé qui souligne les problèmes du vibe coding dans des projets d'envergure.

Malheureusement, tous les devs n'ont pas cette déontologie.

Google déploie son assistant Gemini dans Maps pour accompagner les trajets à pied et à vélo. Cette mise à jour permet d’interroger l’intelligence artificielle sans jamais quitter l’écran de navigation des yeux. Cette nouveauté étend la fonctionnalité conversationnelle initialement lancée en novembre par Google pour le mode conduite. …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article Google Maps ajoute l’IA Gemini pour discuter à pied ou à vélo est apparu en premier sur KultureGeek.

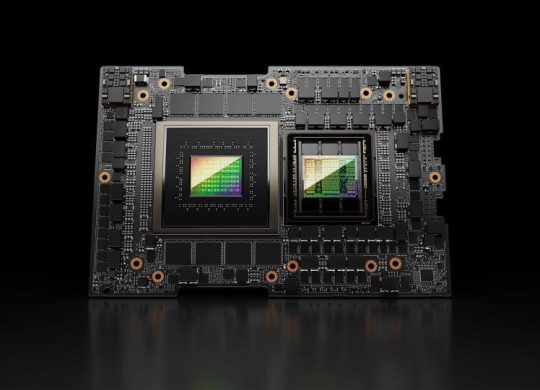

Profitant d’un assouplissement des conditions d’imporations américaines, la Chine accélère le pas. Selon plusieurs informations concordantes, Pékin a donné son feu vert au géant local DeepSeek pour acquérir les puissantes puces H200 de NVIDIA, un feu vert qui s’étend également à ByteDance, Alibaba et Tencent. Au total, jusqu’à …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article DeepSeek autorisé à acheter les puces NVIDIA H200 : la Chine accélère dans la course à l’IA est apparu en premier sur KultureGeek.

Le secteur de l’intelligence artificielle pourrait connaître l’un de ses plus importants mouvements financiers à ce jour. Selon plusieurs sources concordantes, Amazon serait en discussions avancées pour injecter jusqu’à 50 milliards de dollars dans OpenAI, une opération qui pourrait propulser la valorisation de la startup américaine à près …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article Amazon serait en négociations pour investir 50 milliards de dollars dans OpenAI est apparu en premier sur KultureGeek.

Google déploie Project Genie qui permet de générer des mondes interactifs instantanés grâce à l’intelligence artificielle. L’outil convertit un simple texte ou une image importée en un environnement jouable de 60 secondes. Project Genie pour (presque) créer son propre jeu Cette démonstration technique, basée sur le modèle Genie …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article Project Genie de Google génère des mondes jouables par IA est apparu en premier sur KultureGeek.

Vous vous souvenez peut-être de Figure 01 qui nous avait tous bluffés l'année dernière en se faisant couler un petit café (qui a dit "dans sa couche ??) ?

Hé bien, la startup Figure AI ne chôme pas (contrairement à nous le vendredi matin) puisqu'elle vient de dévoiler son Helix 02, la nouvelle version de son cerveau numérique.

Et là, accrochez-vous bien parce qu'on passe un cap ! En effet, ce robot est désormais capable de vider un lave-vaisselle de manière totalement autonome.

Alors je sais ce que vous vous dites : "Super, un truc à 150 000 balles pour faire ce que mon ado refuse de faire gratuitement". Sauf que la prouesse technique derrière est assez dingue. Jusqu'à présent, les robots humanoïdes, notamment ceux de Boston Dynamics (le fameux Atlas), fonctionnaient beaucoup sur de la "théorie du contrôle". En gros, des maths complexes pour garder l'équilibre, et du code impératif pour dire "lève le bras de 30 degrés". C'est hyper précis, mais c'est lourd à coder et ça manque de souplesse.

Là, Figure a tout misé sur une approche pixels-to-action de type "End-to-End". C'est ce qu'ils appellent le System 0.

En gros, ils ont viré un peu moins de 110 000 lignes de code C++ (le langage bien verbeux qu'on adore détester) pour les remplacer par un modèle d'IA unifié. Le robot "regarde" avec ses caméras et le réseau de neurones décide directement des mouvements. Et c'est comme ça que d'un coup, le robot gère tout : l'équilibre, la manipulation des objets glissants, et même la correction de ses propres erreurs en temps réel.

C'est un peu comme si votre Roomba avait soudainement appris à faire du parkour tout en tenant un plateau de verres en cristal.

Bon, vous vous en doutez, le marketing ne nous dévoile pas tout car il y a un petit piège derrière cette innovation. En fait cette approche "tout IA" a aussi des limites car si le modèle hallucine un mouvement, le robot peut très bien décider de lancer votre assiette en porcelaine de Limoges à travers la pièce. C'est donc pour ça qu'ils gardent quand même des garde-fous (System 1 et System 2) pour la planification à long terme. Mais c'est pas encore demain que je laisserai ce machin seul avec mon chat, sauf si je veux le transformer en frisbee ^^.

D'ailleurs, si vous suivez un peu l'actu des robots humanoïdes , vous savez que la concurrence est rude notamment avec l' Optimus de Tesla . Mais perso, je trouve que Figure a carrément une longueur d'avance sur la fluidité "humaine", là où Optimus fait encore un peu "mec bourré qui essaie de marcher droit". J'adorerai avoir un kit de dev pour jouer avec ce truc, mais vu le prix, je vais plutôt me rabattre sur Raspberry Pi... on fait avec ce qu'on a !

Et pour nous les bidouilleurs dans tout ça ?

Hé bien si vous n'avez pas 150 000 $ sous le matelas, sachez qu'il existe des projets open-source comme le ToddlerBot (un petit robot à environ 250$ imprimable en 3D) qui permettent de s'initier à la robotique bipède sans vendre un rein. C'est moins classe que Helix, mais au moins, si ça tombe, ça casse juste du PLA. Un coup de colle et c'est reparti !

Bref, on n'est pas encore au stade où il viendra vous border le soir, mais pour ce qui est des corvées ménagères, ça sent bon la fin de l'esclavage humain (pour le remplacer par celui des machines, mais chut, faut pas leur dire).

Amusez-vous bien !

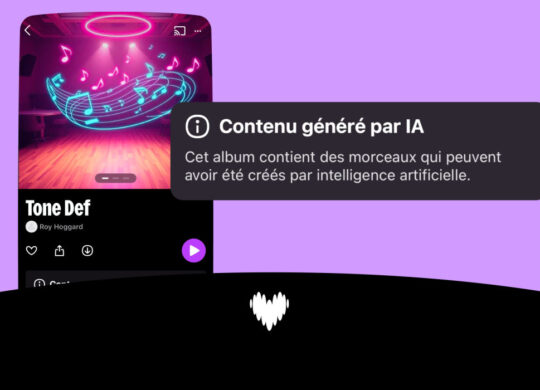

Un an après avoir lancé son propre outil de filtrage, Deezer franchit une nouvelle étape stratégique : la plateforme française met en vente sa technologie de détection de musique générée par intelligence artificielle. Cette ouverture au marché s’adresse directement aux autres acteurs de l’industrie musicale (labels, distributeurs et …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article Deezer propose son outil de détection de musiques IA aux concurrents est apparu en premier sur KultureGeek.

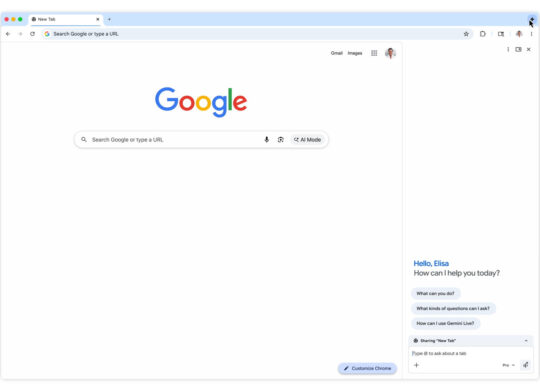

Google dévoile une batterie de fonctionnalités majeures pour Chrome en lien avec Gemini et, donc, l’intelligence artificielle. Au menu : l’intégration profonde de Gemini et, surtout, un mode Auto Browse (navigation automatique) promettant d’automatiser vos tâches les plus complexes sur le Web. Gemini accessible via un panneau latéral …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article Gemini dans Google Chrome ajoute un agent IA pour l’automatisation des tâches est apparu en premier sur KultureGeek.

Microsoft a publié ses résultats financiers pour le trimestre clos fin décembre 2025, et le contraste est frappant entre les scores de la division gaming… et le reste de la société ! Tandis que le groupe affiche une croissance solide portée par le cloud et l’intelligence artificielle, Xbox …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article Résultats : Microsoft dépasse les 80 milliards de CA, mais la division gaming s’écroule est apparu en premier sur KultureGeek.

Bon, celle-là elle est gratinée. NVIDIA, le géant des GPU, a directement contacté Anna's Archive pour accéder à environ 500 To de livres piratés. Contacté, négocié, payé. Comme ça, tranquillou.

C'est une class action (dossier n°1:26-cv-00002 au tribunal fédéral de New York, pour ceux qui veulent aller checker) qui a fait fuiter ces fameux emails internes. En gros, un membre de l'équipe "data strategy" de NVIDIA a négocié un accès haute vitesse aux collections piratées de la bibliothèque. Et le plus beau dans l'histoire c'est qu'Anna's Archive les a PRÉVENUS que les données étaient illégales. Genre, texto : "Vous avez une autorisation interne pour ça ?"

La réponse est arrivée en moins d'une semaine. Feu vert. Sauf que bon, quand on lit ça avec du recul, c'est quand même sacrément culotté.

Le contexte, c'était surtout la pression de livrer pour la GTC 2023 (la Developer Conference de NVIDIA). Fallait nourrir les modèles d'IA coûte que coûte, et le dataset Books3 (196 000 bouquins issus de Bibliotik), plus LibGen, Sci-Hub, Z-Library... ça faisait un buffet de 500 To et de leur côté Anna's Archive facturait des dizaines de milliers de dollars pour l'accès rapide.

Sérieux, j'aurais aimé voir la tête du service juridique de NVIDIA en lisant cet email...

En parallèle, Anna's Archive se prend un procès complètement délirant puisque Spotify, Universal Music, Warner et Sony réclament 13 000 milliards de dollars (13 TRILLIONS, soit à peu près le PIB de la Chine). C'est en lien avec leur backup de 300 To de Spotify dont je vous avais parlé ici. Le juge Rakoff a émis une injonction mondiale le 20 janvier, ce qui a fait tomber plusieurs domaines du site .

NVIDIA plaide le "fair use" évidemment. Mouais. On verra bien ce qu'en pensera le juge, mais quand les emails prouvent qu'on t'a prévenu que c'était illégal et que t'as quand même dit "go"... c'est pas ouf comme défense.

En attendant, entre le procès Spotify et ces emails, Anna's Archive est devenue l'ennemi public numéro un de toute l'industrie du contenu sur le web.

Affaire à suivre !

Après plusieurs mois d’incertitude, la Chine vient d’approuver une première vague d’importations des puces graphiques NVIDIA H200, destinées aux applications avancées en intelligence artificielle. Cette décision marque un tournant stratégique pour l’écosystème technologique chinois, en quête de performances accrues pour ses infrastructures de calcul, et ce malgré un …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article La Chine autorise l’importation des GPU NVIDIA H200 pour accélérer ses ambitions en IA est apparu en premier sur KultureGeek.

Amazon annonce une nouvelle vague massive de licenciements, confirmant l’élimination de 16 000 emplois dans ses bureaux. Cette décision s’inscrit dans une stratégie globale visant à renforcer l’organisation en réduisant les niveaux hiérarchiques et en supprimant la bureaucratie. Ces suppressions d’emplois coïncident directement avec la volonté de l’entreprise …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article Amazon annonce licencier 16 000 employés, préférant l’IA est apparu en premier sur KultureGeek.

La startup américaine Figure AI vient de franchir une étape majeure dans l’histoire de la robotique humanoïde. Avec son nouveau modèle d’intelligence artificielle Helix 02, l’entreprise parvient à unifier locomotion, manipulation et équilibre au sein d’un même système neuronal, ouvrant ainsi la voie à des robots capables d’évoluer …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article Figure AI dévoile Helix 02, une IA qui rapproche le robot humanoïde de l’autonomie totale est apparu en premier sur KultureGeek.

De la génération de scripts complexes au prototypage no-code sur AppSheet, découvrez comment l'IA de Google transforme vos idées en applications fonctionnelles et testables.

Cet article Créer son application avec Gemini : du prompt au prototype est apparu en premier sur Linformatique.org.

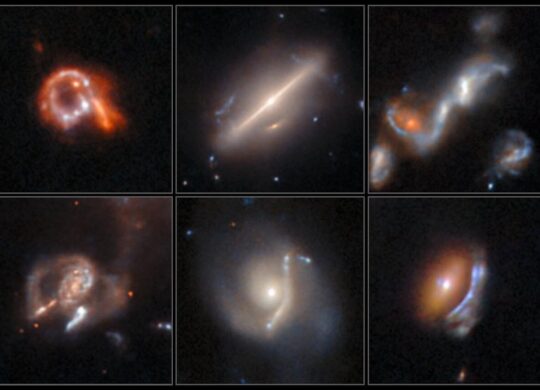

L’intelligence artificielle continue de transformer la recherche scientifique, et l’astronomie en offre une nouvelle démonstration spectaculaire. Deux chercheurs de l’Agence spatiale européenne (ESA) ont ainsi mis au point un outil basé sur un réseau neuronal capable d’explorer automatiquement des volumes massifs d’images spatiales. En moins de trois jours, …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article Une IA révèle plus de 800 anomalies cosmiques dans les archives de Hubble est apparu en premier sur KultureGeek.

La jeune entreprise italienne GEVI Wind veut révolutionner le domaine des énergies renouvelables en concevant une éolienne verticale capable d’adapter ses pales en continu aux variations de vitesse et de direction du vent.

L’article Une éolienne verticale qui ajuste ses pales en quelques millisecondes grace à l’IA, rédigé par Marc Odilon, est apparu en premier sur NeozOne.

Google renforce les capacités visuelles de son modèle Gemini 3 Flash avec une nouvelle fonctionnalité baptisée Agentic Vision. Cette nouvelle fonctionnalité d’IA vise à rendre les réponses liées aux images plus fiables, en ancrant systématiquement l’analyse dans des preuves visuelles concrètes plutôt que dans de simples estimations probabilistes. …

Aimez KultureGeek sur Facebook, et suivez-nous sur Twitter

N'oubliez pas de télécharger notre Application gratuite iAddict pour iPhone et iPad (lien App Store)

L’article Gemini 3 Flash introduit l’« Agentic Vision » pour améliorer l’analyse d’images par l’IA est apparu en premier sur KultureGeek.

Des chercheurs viennent de trouver un truc complètement dingue. Un modèle de langage entraîné UNIQUEMENT sur de l'anglais, du texte humain basique quoi, est capable de comprendre la biologie moléculaire sans jamais avoir vu une seule séquence de protéines durant son entraînement.

En gros, GPT-2 qui fait de la paraphrase d'ordinaire est, sans le savoir, un expert en détection d' homologie protéique . Je vous jure que c'est vrai !!

Liang Wang, chercheur à l'Université de Wuhan (les pangolins, tout ça tout ça, loool), a publié une étude sur bioRxiv qui remet en question pas mal de certitudes. L'idée, c'est que la "grammaire" du langage humain et celle du vivant partagent une structure profonde commune. Du coup, un modèle qui apprend à distinguer des phrases qui ont le même sens mais avec des mots dans un ordre différent... développe aussi la capacité de reconnaitre les protéines qui sont de la même "famille".

Perso, ça me retourne le cerveau parce qu'à la base, on parle "juste" d'un petit GPT-2 de 124 millions de paramètres, entraîné sur le dataset PAWS (des paires de phrases anglaises adverses), qui atteint 84% de précision sur la détection d'homologie protéique. Sans jamais avoir vu d'acides aminés ! C'est comme si votre chat, après avoir appris le français, se mettait soudainement à comprendre le chinois.

Et ça devient encore plus fou quand on scale. Les gros modèles comme Qwen-3 atteignent quasiment 100% de précision sur les benchmarks standards, mais le plus impressionnant, c'est leur performance dans la "zone crépusculaire" de l'évolution, là où les séquences protéiques ont moins de 25% d'identité entre elles. Dans ce régime où même les outils spécialisés comme ESM-2 peinent à maintenir leurs performances, les LLM généralistes maintiennent 75% de précision.

Ils raisonnent là où les autres mémorisent !

D'ailleurs, si vous aimez l'actu IA et biologie, vous avez peut-être déjà lu mes articles sur Evo 2 ou SimpleFold d'Apple . Ces outils-là sont entraînés sur des montagnes de données biologiques alors que dans le cas que je vous expose ici, c'est l'inverse. C'est un LLM tout ce qu'il y a de plus classique qui n'a pas BESOIN de ces données spécifiques pour comprendre la structure du vivant (enfin, ça doit encore être bien validé par d'autres équipes mais on verra bien).

Alors vous vous en doutez, curieux, les chercheurs ont analysé ce qui se passe dans la tête du modèle. Certaines " têtes d'attention " du transformer deviennent des détecteurs universels de différences. La même tête qui repère une inversion sujet-objet dans une phrase anglaise va spontanément repérer les mutations d'acides aminés dans une protéine. Et voilà comment la syntaxe du langage humain et la syntaxe de la vie se retrouvent projetées sur le même "manifold" c'est à dire dans la même "surface" géométrique dans l'espace latent du modèle.

Et quand on demande aux gros modèles d'expliquer leur raisonnement via Chain-of-Thought (enchainement de pensées comme ce que propose ChatGPT 5.2 en mode thinking par exemple), ils font du "mental folding". C'est à dire qu'ils imaginent la structure 3D des protéines à partir de la séquence 1D. Le modèle identifie explicitement des motifs structurels comme " Hélice-Coude-Hélice " versus " Tonneau TIM " pour déterminer si deux protéines sont apparentées. Et tout ça sans jamais avoir reçu de coordonnées 3D en entrée.

Pour formaliser tout ça, l'équipe a donc créé BioPAWS, un benchmark qui évalue la capacité des modèles à transférer leur compréhension syntaxique du langage vers l'ADN, l'ARN et les protéines. Le dataset est dispo sur Hugging Face pour ceux qui veulent jouer avec.

Bref, si la grammaire humaine et la grammaire biologique sont vraiment des manifestations d'une même structure universelle, ça change pas mal de choses sur comment on pourrait faire de la découverte scientifique à moindre coût. Plus besoin de datasets monstrueux pour chaque domaine, les patterns abstraits sont peut-être déjà là, encodés dans le langage qu'on utilise tous les jours.

Vous vous êtes déjà demandé à quoi ressemblerait un magazine fabriqué quasi entièrement par des IA ?

Hé bien ne cherchez plus et allez lire Les Heures Claires ! Il s'agit d'un mensuel d'environ 90 pages où 99% du contenu, des articles aux illustrations, est généré avec l'aide d'outils comme Midjourney, DALL-E 3 ou ChatGPT. "Avec l'aide" ça veut dire qu'il y a quand même des humains derrière, hein...

Le projet est né de l'imagination de Rémi Rostan, un photographe Google Street View certifié et le gars connaît bien l'image et la technologie, car ça se sent dans le résultat.

Concrètement, le mag est découpé en trois sections. Y'a "Les Heures Innovantes" qui cause tech et IA, "Les Heures Claires" qui explore le côté créatif et artistique, et "Les Heures Sombres" pour le ton plus décalé et humoristique. Perso, c'est ce mélange des genres qui rend le truc intéressant... On est donc loin d'un énième catalogue de prompts Midjourney ou d'un PDF SlopAI ^^.

Et d'ailleurs, en parlant de Midjourney, c'est là que GenIArt entre en jeu. Cette communauté francophone, fondée par Nicolas, un fidèle lecteur de Korben.info, en avril 2023, regroupe plus de 3000 membres sur Discord et contribue régulièrement au magazine avec des tutoriels et des techniques de prompt engineering. Ils ont même remporté un prix aux AI Film Awards de Cannes 2025 avec leur clip "Croquette Crew".

Pas mal pour des passionnés !

Côté diffusion, le mag a déjà conquis environ 10 000 lecteurs, avec 1000 à 1500 nouveaux abonnés chaque mois. Vous pouvez le lire gratuitement en PDF et depuis quelques mois, y'a même une version anglaise pour l'international.

Ce qui est vraiment dingue, c'est que Rémi et ses contributeurs utilisent plus de 20 outils IA différents pour produire chaque numéro. Magnific pour l'upscaling, Generative Fill pour les retouches, et tout un arsenal de modèles de langage pour les textes... Et depuis, le projet a évolué avec la création de StudioLHC , un studio créatif qui propose maintenant ses services aux marques et agences qui veulent intégrer l'IA générative dans leur communication.

La boucle est bouclée !

Moi je trouve ça génial. Les articles sont excellents et les illustrations et autres photos, vraiment très bien exécutées. En plus on apprend des choses.

Bref, si vous voulez voir ce que donne la création de contenu assistée par IA quand c'est bien fait, Les Heures Claires est un exemple plutôt convaincant. Ça fait réfléchir sur l'avenir de l'édition... et c'est un peu le but.