Koyeb, un atout PaaS dans les mains de Mistral AI

Une offre d’infrastructure pour l’IA, donnant accès à une stack privée avec une variété d’options de déploiement, du bare metal au PaaS managé. Telle était, dans les grandes lignes, la promesse de Mistral Compute à son lancement mi-2025.

Mistral AI a récemment annoncé un projet à 1,2 Md€ pour implanter, en Suède, un datacenter qui alimentera ce « cloud IA ». Il y ajoute une acquisition. La cible : Koyeb.

Cette entreprise française est née en 2019 à l’initiative de trois anciens de Scaleway*. Isai, Serena Capital et Kima Ventures, entre autres, y ont mis leurs billes. Elle présente aujourd’hui son offre comme une « plate-forme serverless pour les applications IA ». Techniquement, il s’agit d’un PaaS – d’ailleurs encore comparé à Render et à Heroku dans sa documentation.

Du H200 et du B200 depuis peu

À cette partie compute, Koyeb avait adjoint, en 2025, du PostgreSQL managé, en plus de faire la connexion avec diverses bases de données (dont MongoDB, investisseur et client). Il a surtout pris le virage de l’IA en multipliant les options GPU et autres puces accélératrices (les RTX Pro 6000, les H200 et les B200 sont arrivées début 2026). Tout en enrichissant son catalogue de composants déployables « en un clic » (n8n, Ollama, Open WebUI, Unsloth, Jupyter Notebook…) et en développant des intégrations avec les assistants de codage (serveur MCP, pack de skills).

Koyeb s’appuie sur quatre hébergeurs : Equinix, AWS, IBM Cloud et Scaleway. Son plan de contrôle se trouve en Belgique, sur GCP. L’offre se divise en quatre forfaits de base auxquels s’ajoute la consommation de ressources.

Avec le passage dans le giron de Mistral AI (16 employés seront du voyage), le forfait gratuit n’est plus proposé. La plate-forme reste commercialisée indépendamment, en attendant son intégration dans Mistral Compute.

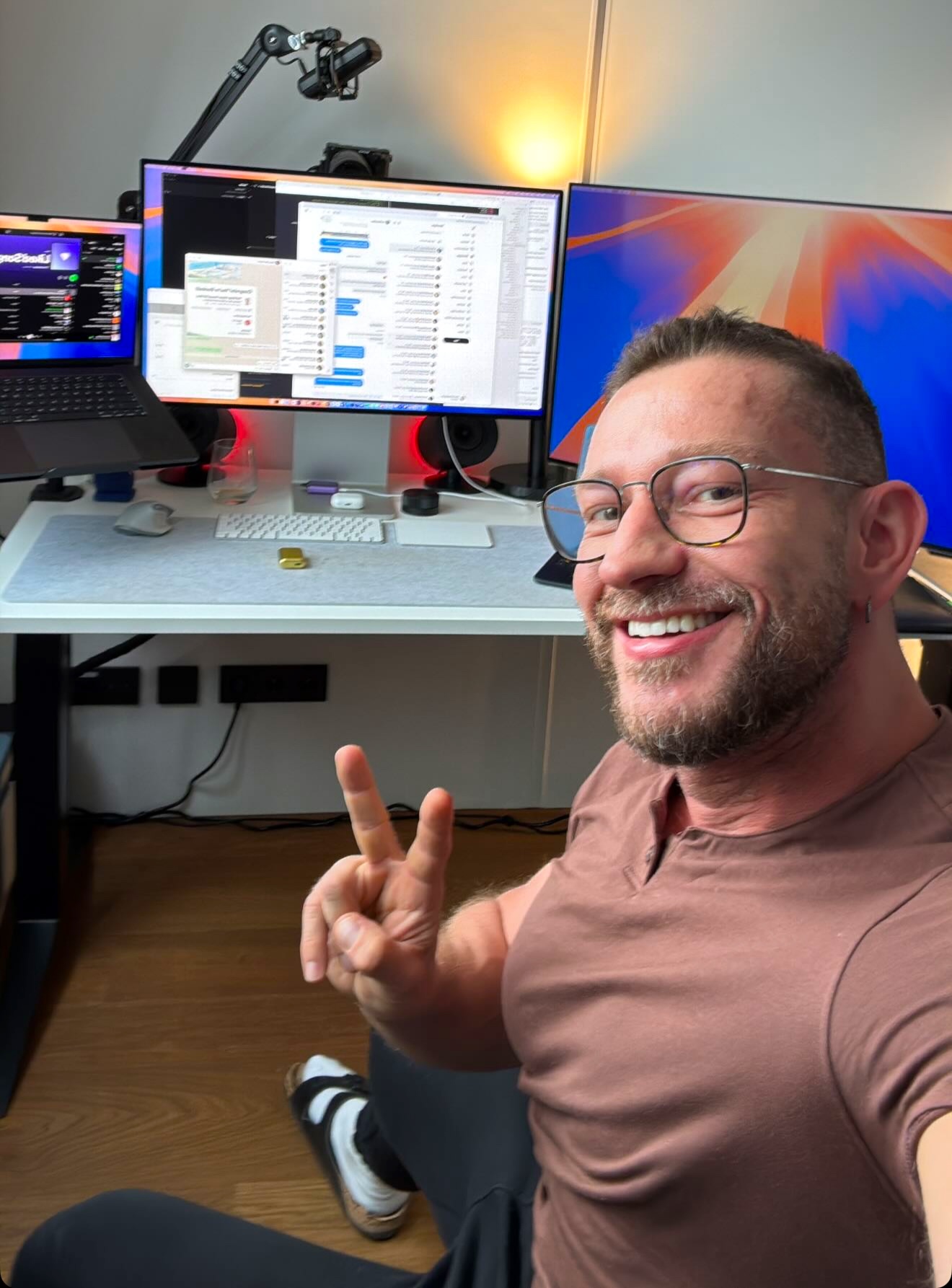

When we first met the @MistralAI team and heard about their vision for Mistral Compute, we saw an incredible opportunity to accelerate the buildup of AI Infrastructure in Europe.

As part of Mistral AI, we’ll pursue our mission to make SOTA AI infrastructure accessible to all

pic.twitter.com/HeM7cJhzqB

— Yann Leger (@yann_eu) February 17, 2026

* Yann Léger, 35 ans, est président de Koyeb. La société a deux DG : Édouard Bonlieu (38 ans, directeur produit) et Bastien Chatelard (37 ans, directeur technique).

Illustration générée par IA

The post Koyeb, un atout PaaS dans les mains de Mistral AI appeared first on Silicon.fr.