Sommaire

Il était une fois

De l’auteur

Je suis, entre autres choses, un amateur de jeux de société, de jeux de rôle, de petits jeux quotidiens (comme Sutom (MIT) ou Le Mot (GPL v3) ou ClueBySam (gratuit, code propriétaire), de petits jeux de réflexion comme GNOME Sudoku (GPLv3+), habitué à recourir à dcode.fr (CC By) pour coder/décoder sur divers jeux (ou à CyberChef (Apache 2) pour des choses plus orientées sécurité) ou de participer à de longues séries d’énigmes genre calendrier de l’Avent (dernièrement celles du ChocoCervo (gratuit à but caritatif, code propriétaire) ou celles de Professeur Zwolle (payant et code propriétaire).

Dans la dernière édition de ce dernier, qui s’est terminée mi-novembre 2025, il y avait une grille codée à résoudre et j’avais adoré le principe de cette énigme à tiroirs. Je me suis demandé qu’elle serait la difficulté à en faire une similaire, voire en augmentant la densité de l’information stockée dans la grille. Bref début décembre 2025, j’ai commencé à remplir une grille (entre diverses résolutions de calendriers de l’Avent orientés énigmes/jeux ou bien sécurité).

Mi-décembre j’avais obtenu le résultat quasi final, mais j’avais du mal à résoudre moi-même l’énigme, donc il fallait réduire sa difficulté et ma motivation a baissé avec une fin d’année compliquée. Et début 2026, en rediscutant avec des amis de l’énigme en préparation, la motivation est revenue, j’ai fini de retester en une soirée, découvert une typo qui a nécessité des corrections de dernière minute, et le lendemain, tout était prêt pour la publication.

La publication

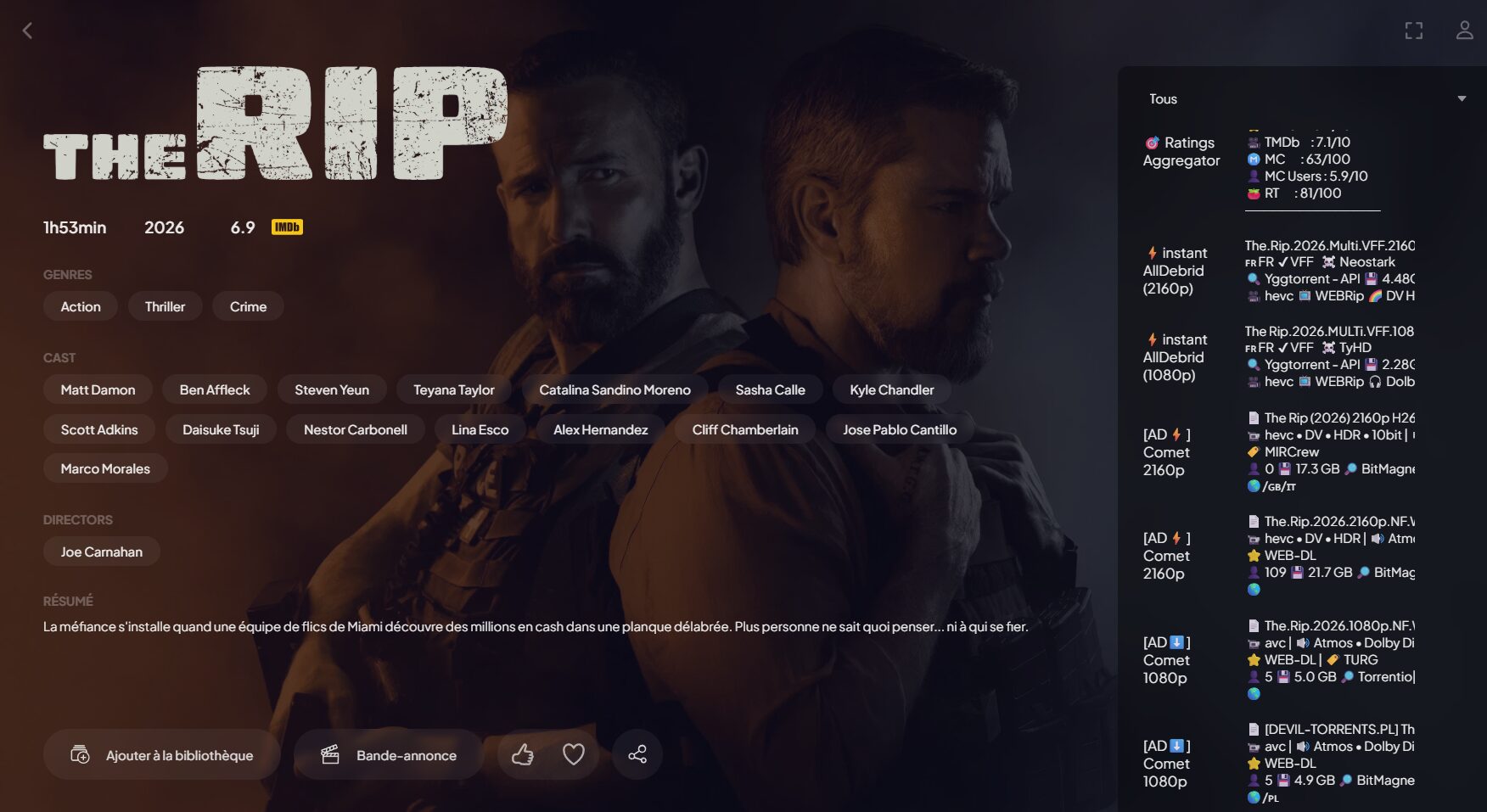

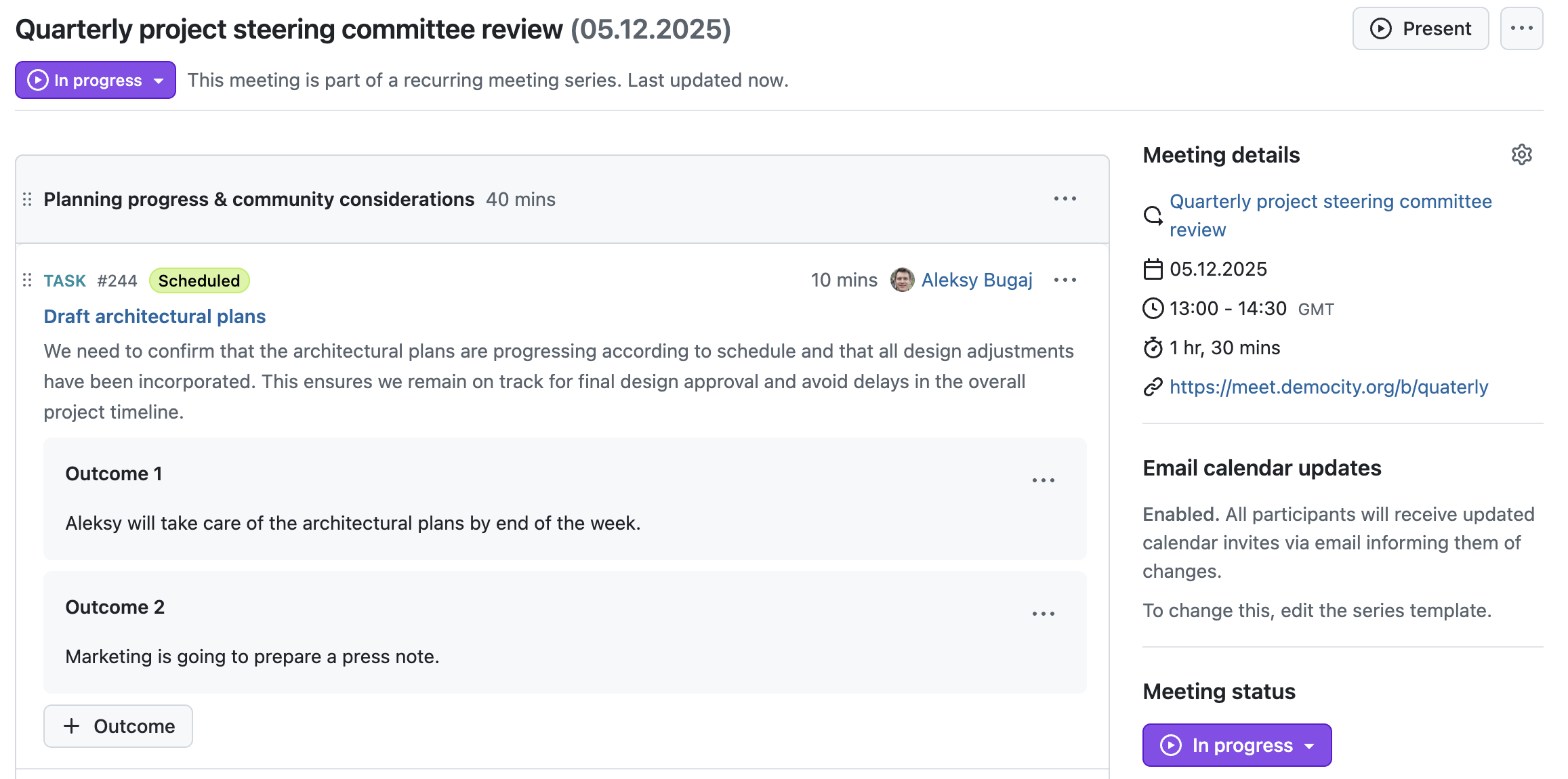

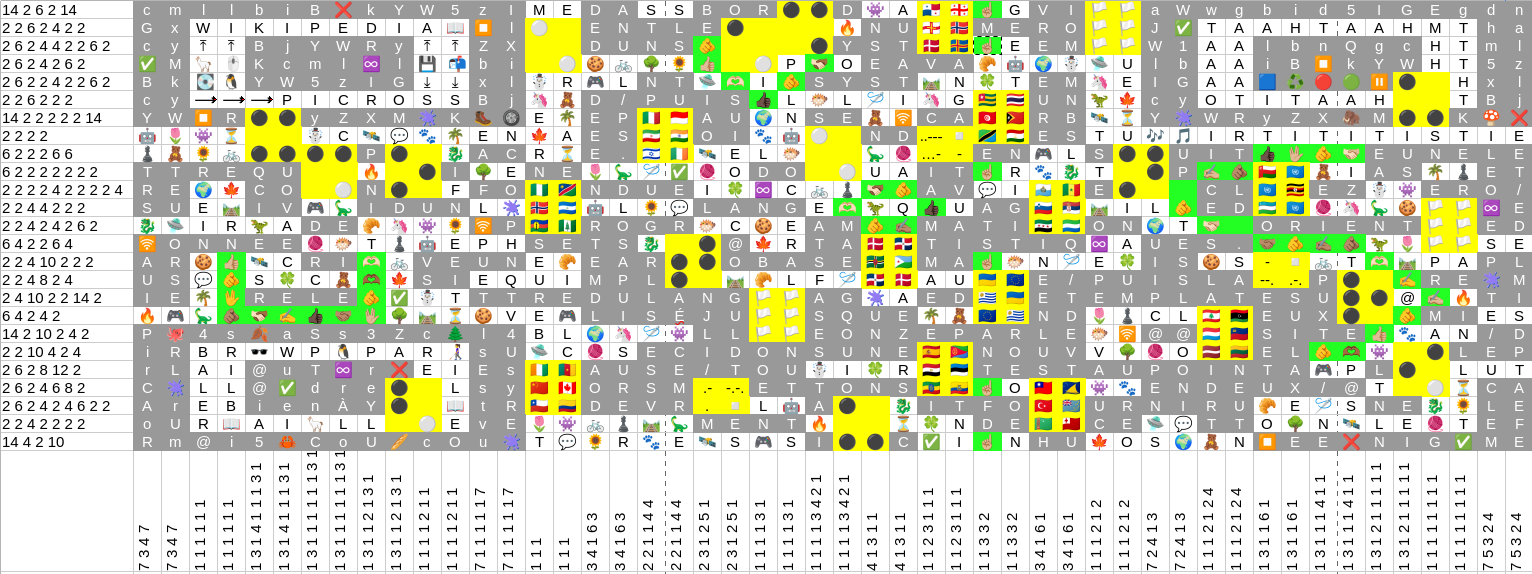

J’avais produit mon beau tableau Markdown pour publier directement sur LinuxFr.org (c’était un peu l’idée initiale). J’admire donc le résultat de mon copier-coller. Et le résultat est illisible, car le tableau est assez grand avec 26 lignes et 51 colonnes. Et surtout la dernière ligne contient du texte assez large dans chaque colonne, si on n’affiche pas le texte verticalement. Ce que ne permet pas LinuxFr.org. Bon, de toute façon, c’est nettement plus facile à résoudre dans un tableur genre LibreOffice (MPL 2.0) et j’ai d’ailleurs rapidement suggéré de l’utiliser en réglant la largeur des colonnes sauf la première à 0,7 cm par exemple, et d’ajuster l’affichage du texte en vertical pour la dernière ligne. Voir par exemple le rendu en image.

Vient ensuite le petit poème (que je vais amputer involontairement initialement en le terminant par « mater » au lieu de « materas », nuisant à la rime certes, mais sans effet sur la résolution) :

Il y aura du blanc, il y aura du noir.

Criards sont ⚫ et ⚪, parce qu’ils braillent.

Qu’un fond de la même couleur leur aille.

Similitude des drapeaux, vers un espoir ?

Bariolés ils finiront néanmoins blancs.

Tout comme la ponctuation qui n’en est pas.

Mêmes six dans une colonne, des éléments

D’autres parties à chercher, ensuite materas.

Normalement, avec le titre, le tableau bariolé cryptique plein de symboles et les vers bizarres, le lectorat comprend qu’il s’agit d’une énigme à résoudre, pour découvrir un « grand secret du site » donc. Voire un second secret.

La résolution

Le picross

La variété dans le tableau est le signe qu’il y a différentes choses à trouver, donc on peut commencer de différentes façons.

Les amateurs de jeu ont sans doute déjà reconnu un picross (Wikipédia nous dira qu’il est « connu sous de nombreux autres noms : Crucipixel ; Edel ; FigurePic ; gameLO; Grafilogika ; Griddlers ; Hanjie ; Illust-Logic ; Japanese Crosswords ; Japanilaiset Ristikot ; Japanese Puzzels ; Kare Karala! ; Logic Art ; Logic Square ; Logicolor ; Logigraphe ; Logik-Puzzles ; Logimage ; Nonograms ; Oekaki Logic ; Oekaki-Mate ; Paint by numbers ; Paint Logic ; Pic-a-Pix ; Pikurosu ; Pixel Puzzles ; Puzzle Giapponese ; Puzzle Japones ; Shchor Uftor ; Tsunami ; Pictopix. »). Pour les autres, j’avais donné un indice avec « Une façon de commencer est de regarder ce qui est lisible et qui flèche la résolution. » Dans le coin supérieur gauche, on voit les mots WIKIPEDIA et PICROSS qui sont pointés par des flèches.

|

|

|

|

|

|

|

|

|

|

| W |

I |

K |

I |

P |

E |

D |

I |

A |

📖 |

| ⤒ |

⤒ |

B |

j |

Y |

W |

R |

y |

⤒ |

⤒ |

| 🦙 |

🖱️ |

K |

c |

m |

l |

♾️ |

l |

💾 |

📬 |

| 💽 |

🐧 |

Y |

W |

5 |

z |

I |

G |

⤓ |

⤓ |

| ⟶ |

⟶ |

⟶ |

P |

I |

C |

R |

O |

S |

S |

Un autre indice était le vers « Il y aura du blanc, il y aura du noir. ». Effectivement on va avoir besoin de cases noires et blanches (plutôt gris clair et foncé pour pouvoir lire le contenu en pratique), et pas que pour le picross. On va aussi s’aider de « ⚫ et ⚪ (…) Qu’un fond de la même couleur leur aille. » (donc les ronds noirs sont des cases noires et les ronds blancs des cases blanches. Et enfin on va s’aider de « drapeaux (…) ils finiront néanmoins blancs », donc les drapeaux sont des cases blanches, et de « Tout comme la ponctuation », dont la « ponctuation » (voire plus loin, mais on parle ici des cases contenant des points et des tirets) est aussi sur des cases blanches.

Ne reste plus qu’à résoudre le picross. Et on découvre un QR-code 50x25 (en fait 25x25 les cases étant dédoublées). Il a été produit ainsi avec le paquet go-qrcode (licence Expat), -t pour la sortie texte, -s pour la taille, -d pour éviter la bordure :

qrcode -t -d -s 33 "1 Le site " > qrcode.txt

Ce qui donne un 33x33 mais 25x25 sans le cadre. Avec une petite moulinette de 48 lignes assez basique nommée pycross-me.py je l’ai converti en un picross. Et une dernière commande vient remplacer les blancs (espaces) par des @ et les noirs par des espaces pour faciliter la lecture dans un tableau ensuite.

./pycross-me.py qrcode.txt |sed -e 's/" "/"@"/g' -e 's/"█"/" "/g' > qrcode.csv

Le qrcode.txt :

██ ██ ██████ ██

██████████ ██ ████ ██ ██ ██████████

██ ██ ██ ████ ████ ██ ██ ██

██ ██ ████████████ ██████ ██ ██

██ ██ ████ ████ ████ ██ ██ ██

██████████ ██ ██████████ ██ ██████████

██ ██ ██ ██ ██ ██

████████████████ ██ ████ ████ ████████████████

████ ██ ██ ████████████ ██ ████

████ ██ ██████ ████ ██████ ██████ ██

██ ██ ██ ██ ████████ ████ ██ ██ ██

██ ██ ████████ ██████ ██████ ████████

██████ ████ ██ ████ ██ ██ ████ ██

████████ ██ ██ ██ ██ ██████████

████ ██ ██ ██ ██████ ██████████

████████ ████ ████████████ ██ ██

██ ████ ██ ██ ██ ██

████████████████ ██ ████ ██████ ██ ██

██████ ██ ██ ██ ████

██████████ ████ ██ ██████ ████

██ ██ ██ ██████ ██ ████

██ ██ ██ ██ ████████ ████

██ ██ ██ ████ ██ ██ ████ ██

██████████ ██████ ██████ ██ ██ ████████

██████████ ████ ██████

Bref ce qu’il fallait trouver dans cette sous-partie était « 1 Le site ».

Le coin en haut à gauche

La partie blanche était celle contenant WIKIPEDIA et PICROSS précédemment évoquée, plus quelques émojis pour décorer (dont un lama déchaîné et un manchot, et divers moyens de stockage d’information).

On ne conservant que la partie noire dans cette partie on a ce qui suit :

|

|

|

|

|

|

|

|

|

|

|

|

|

| c |

m |

l |

l |

b |

i |

B |

❌ |

k |

Y |

W |

5 |

z |

| G |

x |

|

|

|

|

|

|

|

|

|

|

⏹️ |

| c |

y |

|

|

B |

j |

Y |

W |

R |

y |

|

|

Z |

| ✅ |

M |

|

|

K |

c |

m |

l |

♾️ |

l |

|

|

b |

| B |

k |

|

|

Y |

W |

5 |

z |

I |

G |

|

|

x |

| c |

y |

|

|

|

|

|

|

|

|

|

|

B |

| Y |

W |

⏹️ |

R |

⚫ |

⚫ |

y |

Z |

X |

M |

|

K |

🥾 |

On peut noter que c’est une des rares zones comportant des minuscules. Et la raison est qu’on peut y lire la phrase cmllbiBkYW5zIGxlcyBjYWRyZXMK répétée deux fois, qui est nettement plus lisible si on devine qu’il s’agit d’un codage base64 :

$ echo cmllbiBkYW5zIGxlcyBjYWRyZXMKcmllbiBkYW5zIGxlcyBjYWRyZXMK|base64 -d

rien dans les cadres

rien dans les cadres

Bref ça ne sert à rien.

Le coin en bas à gauche

D’abord la partie en blanc :

|

|

|

|

|

|

|

|

|

|

| B |

R |

🕶️ |

W |

P |

🐧 |

P |

A |

R |

👩🦯 |

| A |

I |

|

|

|

|

|

|

E |

I |

| L |

L |

|

|

|

|

|

|

|

L |

| E |

B |

|

|

|

|

|

|

|

📖 |

| R |

📖 |

A |

I |

🦙 |

L |

L |

|

⚪ |

E |

On a donc une dame avec une canne blanche, des lunettes noires, deux fois Braille, un « WP (pour Wikipédia) pareil » (que pour Picross), et les habituels manchot et lama déchaîné. Bref c’est un indice pour une autre partie, mais pas de réponse en vue si je puis dire.

Alors la partie en noir :

|

|

|

|

|

|

|

|

|

|

|

|

|

| P |

🐙 |

4 |

s |

🍂 |

a |

S |

s |

3 |

Z |

c |

🌲 |

l |

| i |

R |

|

|

|

|

|

|

|

|

|

|

s |

| r |

L |

|

|

@ |

u |

T |

♾️ |

r |

❌ |

|

|

E |

| C |

|

|

|

@ |

✅ |

d |

r |

e |

⚫ |

|

|

s |

| A |

r |

|

|

i |

e |

n |

À |

Y |

⚫ |

|

|

t |

| o |

U |

|

|

|

|

|

|

|

|

|

|

v |

| R |

m |

@ |

i |

5 |

🦀 |

C |

o |

U |

🥖 |

c |

O |

u |

Une fois les émojis décoratifs retirés, on peut lire « P4s aSs3Z cl4iR sUr L (sic) @uTrEs C@dres y A rien À Y tRoUvER m@i5 CoUcOu » (la fôte n’était pas voulue) pour « Pas assez clair sur les autres cadres ? Y a rien à trouver, mais coucou. »

Le coin en haut à droite

D’abord la partie en blanc :

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| T |

A |

A |

H |

T |

A |

A |

H |

M |

| A |

A |

|

|

|

|

|

|

H |

| A |

A |

|

|

|

|

|

|

H |

| A |

A |

|

|

|

|

|

|

|

| O |

T |

I |

T |

A |

A |

H |

|

|

| 🎶 |

🎵 |

I |

R |

T |

I |

T |

I |

T |

Qu’il faut lire comme du code morse avec des tirets longs dits « taah » et des points courts dits « ti » (et des notes de musique pour suggérer les sons).

taah taah -> M

taah taah taah -> O

ti taah ti -> R

ti ti ti -> S

ti -> E

Super, on a « morse » codé en morse. Et on n’a rien appris.

Puis la partie en noir :

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

|

| a |

W |

w |

g |

b |

i |

d |

5 |

I |

G |

E |

g |

d |

| J |

✅ |

|

|

|

|

|

|

|

|

|

|

h |

| W |

1 |

|

|

l |

b |

n |

Q |

g |

c |

|

|

m |

| l |

b |

|

|

i |

B |

⏹️ |

k |

Y |

W |

|

|

5 |

| I |

G |

|

|

🟦 |

|

🔴 |

🟢 |

⏸️ |

|

|

H |

x |

| c |

y |

|

|

|

|

|

|

|

|

|

|

B |

| Y |

|

W |

R |

y |

Z |

X |

🦣 |

M |

|

⚫ |

K |

🍄 |

Encore des minuscules et encore du base64.

echo aWwgbid5IGEgdnJhaW1lbnQgcmllbiBkYW5zIGxlcyBjYWRyZXMK|base64 -d

il n’y a vraiment rien dans les cadres

Le cœur de la grille

Dans la partie en blanc, on peut lire (après remise en forme) « message pour l’intelligence naturelle ou artificielle qui lira cette phrase ce n’est pas ce qu’il faut avec les blancs voir plutôt les non-lettres sinosn (sic) » (la typo est involontaire).

Dans la partie en noir, on peut lire (après remise en forme) :

D’abord vient le numéro d’un système avant le systemd.

Puis une pause car besoin d’espace.

Ensuite une lettre qui ne doit pas être confondue avec le zéro.

Suivi d’un langage de programmation orienté données et statistiques.

Arrive une arobase mais plus simple.

Puis la première lettre du langage de templates utilisé jusqu’en deux-mille onze > par le site.

Décidons une nouvelle pause.

Tout est au point, alors mettons-en deux.

Les réponses étant 5 (System V), espace, o, r, a, t (Templeet), espace, :.

L’élément est donc « 5 orat : ».

Le braille

On aurait pu faire le braille dès le début, sans résoudre le picross. Il était indiqué par « ⚫ et ⚪, parce qu’ils braillent. »

Les ronds noirs (avec l’aide des ronds blancs pour savoir où sont situés les 3 lignes et 2 colonnes codant un caractère braille) permettent de lire de haut en bas et de gauche à droite le message « 3 aux contribu » (la première zone code un chiffre, la seconde est entièrement blanche donc vide donc espace, et les suivantes codent des lettres).

Le morse

On aurait pu faire le morse dès le début, sans résoudre le picross. Le vers parle de « ponctuation qui n’en est pas » et il faut donc y voir du morse dans les parties comportant des points et des tirets. On peut déchiffrer « 2 vit grâce » (la première zone code un chiffre, la seconde est◽donc espace, et les suivantes codent des lettres).

Les drapeaux

On aurait pu faire les drapeaux dès le début, sans résoudre le picross. Le vers parle de « Similitude des drapeaux ». Il faut remarquer que dans le premier groupe de six ils ont en commun un partage en 4. Le second groupe ne comporte que des drapeaux blancs, donc espace. Et chacun des autres groupes va coder une lettre, la première lettre commune des pays concernés. Le message à trouver était donc « 4 tions du lect ».

Les six

On aurait pu faire les six dès le début, sans résoudre le picross. Les derniers vers non encore utilisés sont

Mêmes six dans une colonne, des éléments

D’autres parties à chercher, ensuite materas.

Une petite observation montre qu’il existe une colonne avec six fois le caractère Unicode☝🏼. On cherche donc des mains et des doigts. Et si leurs emplacements dessinent les lettres v, o, u et s. Le message à trouver était donc « 6 vous »

La solution

Le grand secret

Les six éléments trouvés et remis dans l’ordre donne la phrase suivante : « Le site vit grâce aux contributions du lectorat : vous ». Ce qui est effectivement le grand secret de LinuxFr.org, site qui vit par et pour vous. Il figure d’ailleurs en première phrase sur la page pour proposer un contenu.

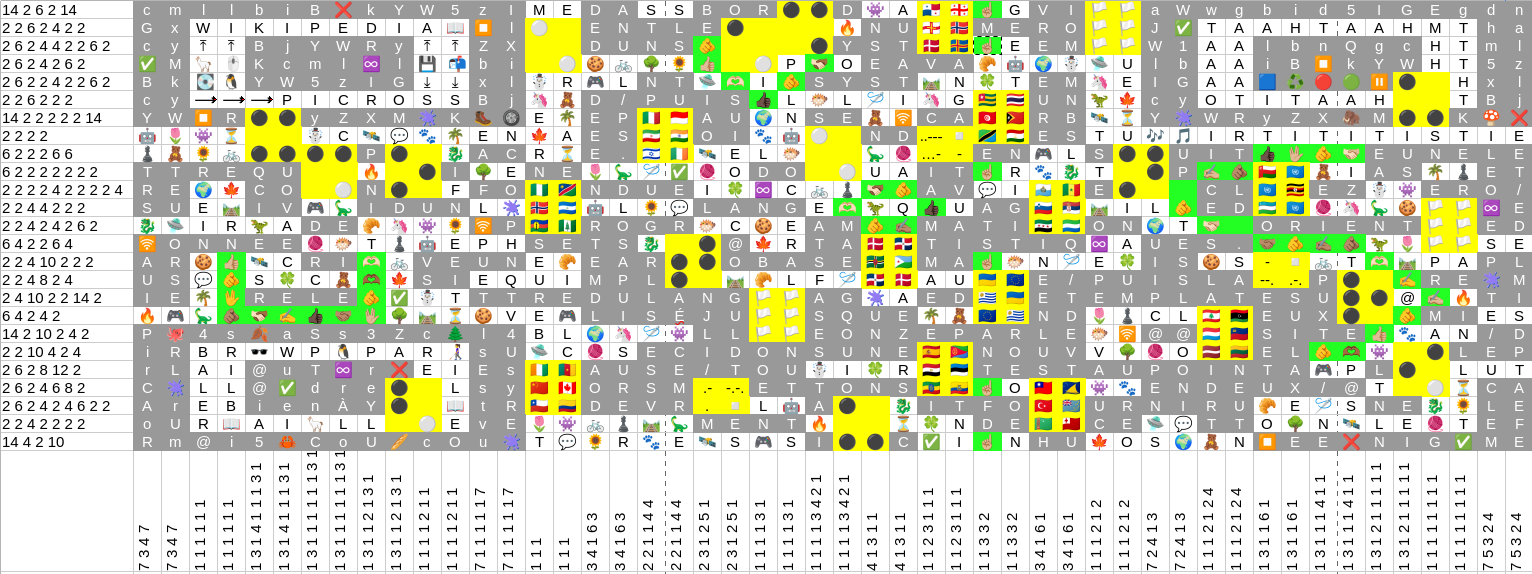

Et voici une visualisation de la solution complète de la grille :

Un second secret ?

Au moment où j’ai écrit le journal, je me suis dit que la résolution pourrait être longue et difficile, qu’une personne seule aurait dû mal à la faire, qu’elle aurait besoin de l’aide, des suggestions, des pistes, des idées, des erreurs, des indices et de la motivation apportée par d’autres personnes. Que sur un site contributif les personnes allaient s’entraider et se nourrir des questions/réponses des autres via les commentaires. Et c’est bien, selon moi, le second grand secret derrière LinuxFr.org. Je ne pouvais que pressentir les commentaires qui viendraient par la suite sous le journal d’annonce de l’énigme.

A posteriori

De la création d’énigme

Voici mes quelques impressions retour sur la création d’une telle énigme :

- je voulais le plus petit QRcode possible pour avoir une petite grille, mais au final elle n’est pas si petite que cela, et cela veut dire des tests longs et pénibles, des soucis d’affichage sur le site à la publication, et une plus grande difficulté pour résoudre ;

- je suis satisfait de la quantité d’informations que j’ai pu glisser dans la grille : toutes les cases sont utiles à l’exception des émojis servant de diversions pour la partie « les six ». Et cela inclus des indices glissés pour suggérer le picross, le braille et le morse, ainsi que des fausses pistes ;

- l'Unicode et les emojis offrent vraiment plein de possibilités pour des énigmes basées sur du texte et des symboles ;

- il reste plus de typos que l’on pense, parce que c’est difficile/pénible à relire. Celle trouvée la veille de la publication aurait pu obliger à tout décaler dans la grille, ce qui aurait pu être très pénible (j’ai pu m’en sortir avec un changement singulier/pluriel qui a limité le décalage à une seule phrase). Et de fait il en reste après les publications (il faut dire qu’il n’y a pas eu d’équipe de bêta-test, personne n’était au courant de la publication) ;

- la capacité à être résolue a été un souci : je connaissais le QRcode, mais il ne pouvait servir directement de picross. J’ai donc rajouté des zones pour le braille, les drapeaux et le morse avec des couleurs définies, pour qu’il soit faisable. Et ensuite il faut tout retester depuis le début pour vérifier. La quantité de zones ajoutées augmente ou diminue la difficulté de la partie picross ;

- je n’avais pas conçu en amont plus que « qrcode pour faire un picross » et en ajoutant les autres parties au fur et à mesure, on se retrouve à devoir revoir des cases (c’est complètement le cas de la partie « les six » qui a consisté à trouver où je pourrais dessiner mes lettres et à remplacer des cases déjà remplies d’autres émojis ;

- à défaut de pouvoir tout recréer/régénérer automatiquement, il est important de garder des notes de ce qui a été fait, des différentes énigmes et des solutions, ça évite de devoir re-résoudre plusieurs fois, et ça aide pour écrire la solution in extenso ensuite ;

- c’est assez fun de construire les différentes parties, de mettre des indices, des fausses pistes, des blagues semi-privées sur le manchot et le lama déchaîné, ou les dinosaures parce que tout le monde aime les dinosaures ;

- il y a une certaine fébrilité à la publication (y aura-t-il de l’intérêt ou pas ? Y aura-t-il des résolutions complètes ou non ? Y aura-t-il de l’entraide ?), puis une attente (ça fait déjà 5min que c’est publié et personne n’a tout résolu encore ? Bon 10 min maintenant. Et après quelques heures ?) et enfin un petit jeu sur comment donner des indices sans donner les réponses directement (c’est clairement la meilleure partie, les échanges par commentaires interposés sur le site, et avec Bookynette & Echarp via Signal (AGPLv3).

Et ensuite ?

Ce n’est pas la première fois que j’organise un jeu de ce type sur le site, il y a eu plusieurs fois des chasses aux œufs durant des vacances autour de Pâques (en 2020 et 2021). C’est la première fois que cela prend cette forme d’une énigme mystérieuse. Peut-être qu’il y en aura d’autres ainsi, peut-être pas, cela dépend de vos retours, de la motivation et de l’inspiration. Et de l’envie éventuelle de tester d’autres formes (un escape game ? Quelque chose basé sur le site lui-même ? Ou bien en dehors en utilisant des ressources libres genre OpenStreetMap ou OpenFoodFacts ?). De faire quelque chose en partenariat avec l’April, qui a déjà fait un jeu de l’oie et un espace game ?

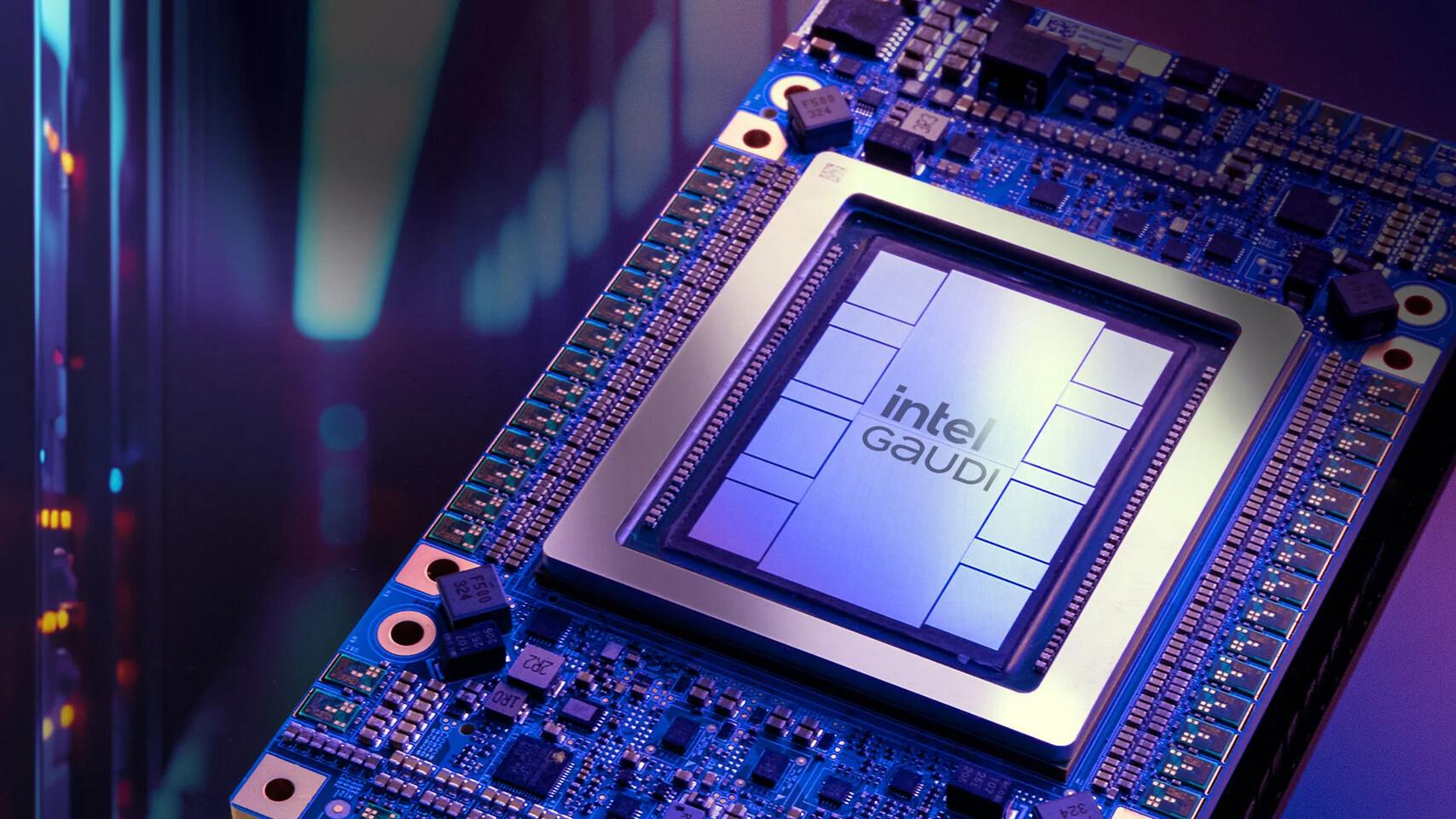

Dans un article au titre volontairement racoleur et donc un peu trompeur, Exclusive: NVIDIA to reportedly shift 2028 chip production to Intel, reshaping TSMC strategy, le DigiTimes avance que NVIDIA fera appel à Intel Foundry pour sa future génération Feynman (l'après Rubin). Du moins, partiellement...

Dans un article au titre volontairement racoleur et donc un peu trompeur, Exclusive: NVIDIA to reportedly shift 2028 chip production to Intel, reshaping TSMC strategy, le DigiTimes avance que NVIDIA fera appel à Intel Foundry pour sa future génération Feynman (l'après Rubin). Du moins, partiellement...

L’information a depuis été reprise çà et là, mais c’est en fin de semaine dernière que CRN, ou encore le compte X d’un certain Haze, ont rapporté le débauchage d’Eric Demers par Intel. Il officiait depuis quatorze ans chez Qualcomm, et s'était distingué chez ATI / AMD auparavant...

L’information a depuis été reprise çà et là, mais c’est en fin de semaine dernière que CRN, ou encore le compte X d’un certain Haze, ont rapporté le débauchage d’Eric Demers par Intel. Il officiait depuis quatorze ans chez Qualcomm, et s'était distingué chez ATI / AMD auparavant...